Relu

Relu(Linear rectification function)是深度学习中的一种激活函数

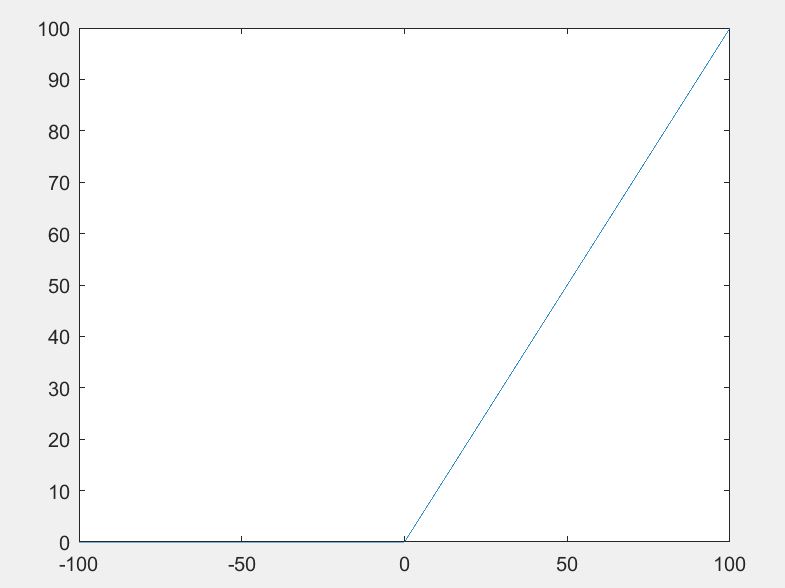

其函数表达式为:f(x)=max(0,x)

其函数图像为:

该函数主要用于cnn卷积神经网络的卷积(Convolution)和池化(MaxPooling)中,因为经过卷积运算和池化运算后的图像矩阵的值有正有负,这难免造成了数据规模变得很大,那么经过Relu函数之后的图像矩阵中的值只留下正数的值。

优点:

1.极大地减少了数据量#

2.在一定程度上减少了运算量#

3.避免层数增加。

0.0分

2 人评分

精彩推荐

C语言训练-求矩阵的两对角线上的元素之和 (C语言代码)浏览:600 |

WU-蓝桥杯算法提高VIP-Quadratic Equation (C++代码)浏览:1752 |

字符逆序 (C语言代码)浏览:460 |

矩阵乘方 (C语言代码)浏览:1030 |

C语言程序设计教程(第三版)课后习题5.6 (C语言代码)浏览:560 |

printf基础练习2 (C语言代码)浏览:504 |

C语言程序设计教程(第三版)课后习题10.1 (C语言代码)浏览:535 |

整数平均值 (C语言代码)浏览:786 |

简单的a+b (C语言代码)浏览:630 |

数列问题 (C语言代码)浏览:1022 |